Outils pour utilisateurs

mpi:intel-mpi:fabric

Ceci est une ancienne révision du document !

Table des matières

Intel MPI et Fabric

Cet article traite du choix de la Fabric par la librairie Intel MPI.

Une Fabric ?

- Sous ce terme, on désigne un type de “réseau” de communication (

à détailler)

à détailler) - La librairie Intel MPI est capable d'utiliser plusieurs Fabric différentes

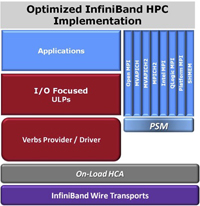

Infiniband : PSM vs. Verbs

http://www.scientificcomputing.com/articles/2011/09/infiniband-architecture-impact-cpu-utilization

Verbs et PSM sont seux approches différentes pour les communications MPI sur IB

Verbs

- date des origines d'IB

- interface entre les protocoles de haut niveau et le HCA (Host Controler, carte IB)

- orienté connexion ⇒ lourd

- conséquence, a besoin de HCA avec capacité d'offload

- conçu pour des I/O à la base

- MPI a été ensuite adapté pour utiliser Verbs directement … mais ce n'est pas très adapté

Schéma Verbs

PSM

- Performance Scaled Messaging

- postérieur à Verbs

- écrit pour MPI (et donc très bien adapté)

- réside en user space sous forme d'une librairie

- beaucoup plus léger que Verbs

- utilise un découpage des rôles différents de Verbs : la partie “transport” est exécutée par le driver, et non par le HCA. Il n'utilise pas de technologie d'offload

Schéma PSM

Fabric supportées

shm | Mémoire partagée |

|---|---|

dapl | DAPL-capable network fabrics, such as InfiniBand, iWarp, Dolphin, and XPMEM (through DAPL) |

tcp | TCP/IP-capable network fabrics, such as Ethernet and InfiniBand (through IPoIB) |

tmi | TMI-capable network fabrics including Intel True Scale Fabric, Myrinet, (through Tag Matching Interface) |

ofa | OFA-capable network fabric including InfiniBand* (through OFED verbs) |

shm

- Ce type de Fabric concerne seulement les machines à mémoires partagées, comme son nom l'indique

- Utilisable pour des communication au sein d'un nœud de calcul

tcp

- Utilise le protocole réseau TCP, développé à l'origine pour TCP/IP

- Lent …

- Peut fonctionner

- sur ethernet

- sur Infiniband à travers la couche “IPoIB” (IP over Infiniband) qui est activée sur CALI

- A réserver aux anciens nœuds de calcul sans connexion IB

dapl

- Direct Access Programming Library

- Protocole de couche haute pour réseau Infiniband

- N'est pas conseillé

ofa / verbs

Fabric utilisées :

$ echo $I_MPI_FABRICS shm:tmi

PSM est un TMI Provider. Sélectionné via la configuration du fichier /opt/software/intel/impi_latest/etc64/tmi.conf

- Pourquoi ne pas utiliser DAPL ?

- Est-ce que le RDMA fonctionne ?

mpi/intel-mpi/fabric.1434557435.txt.gz · Dernière modification: 2015/06/17 18:10 de montap01